IA en entreprise : de l'adoption à la création de valeur

Mars 2026 | Par les associées de LYVE Advisory

Le paradoxe du déploiement

Les gains de productivité liés au déploiement de l’intelligence artificielle existent et sont documentés. Une étude publiée dans le Quarterly Journal of Economics, portant sur 5 172 agents de support client dans une entreprise du Fortune 500, mesure une hausse de productivité moyenne de 15 % après déploiement d'un assistant génératif – atteignant 30 % pour les profils les moins expérimentés[1].

Dans le même temps, selon la dernière édition du McKinsey Global Survey on the state of AI[2], 88 % des organisations déclarent désormais utiliser l'IA de manière régulière dans au moins une fonction métier, contre 78 % un an auparavant. Pour autant, les deux tiers n'ont pas encore commencé à déployer l'IA à l'échelle de l'entreprise : 32 % en sont au stade de l'expérimentation, 30 % au pilotage, et seulement 7 % ont atteint un déploiement pleinement intégré.

Et pourtant, la plupart des organisations qui ont franchi le cap de l'adoption naviguent sans direction définie. Les outils sont en place et les premières métriques sont prometteuses, mais la trajectoire stratégique est absente et les questions fondamentales de gouvernance n'ont pas été posées.

Ce paradoxe est le signe d'une erreur de séquençage et, potentiellement, le prélude à une désillusion coûteuse.

I. Stratégie : se doter d'une boussole avant d'avancer

Déployer l'IA sans cadre stratégique préalable, c'est reproduire une erreur fréquente : confondre l'efficacité opérationnelle et la stratégie. Michael Porter l'a établi clairement[3] : l'efficacité opérationnelle – faire mieux ce que tout le monde fait, avec les mêmes outils – n'est pas une stratégie. Lorsque toutes les organisations adoptent les mêmes technologies de productivité, les gains se neutralisent par convergence compétitive. L'amélioration devient un coût de participation au marché, non une source de différenciation. Ce qui crée un avantage véritable, c'est un positionnement unique, une combinaison d'activités délibérément choisies, adossée à des arbitrages explicites sur ce que l'on ne fera pas.

Or cette logique d'arbitrage fait défaut dans beaucoup de déploiements IA observés aujourd'hui. Cela s’explique par un mécanisme identifié par Paul DiMaggio et Walter Powell qui ont montré que face à l'incertitude, les organisations tendent à imiter les pratiques de leurs pairs perçus comme légitimes, parce qu'elles réduisent l'anxiété décisionnelle[4]. C'est ce qu'ils nomment l'isomorphisme mimétique : un réflexe de conformité qui se substitue à l'analyse stratégique. S’agissant du déploiement de l'IA, le phénomène semble limpide. Sous la pression des investisseurs, des benchmarks sectoriels et des annonces concurrentielles, la question dominante est devenue « comment fait-on comme les autres ? » au détriment de : « où voulons-nous aller, et l'IA peut-elle nous y aider ? ».

Sans cap stratégique, les initiatives IA se multiplient par sédimentation : chaque fonction déploie selon ses propres priorités, sans cohérence interfonctionnelle ni critère de priorisation partagé. Les gains de productivité obtenus localement ne sont pas réalloués vers les usages à plus forte valeur et ils se diluent faute de priorisation. Le constat de McKinsey l'illustre : 64 % des répondants estiment que l'IA améliore leur capacité d'innovation, mais seuls 39 % lui attribuent un impact mesurable sur l'EBIT, et parmi eux, la majorité évalue cet impact à moins de 5 % du résultat.

L'étude du BCG, The Widening AI Value Gap[5], portant sur plus de 1 250 entreprises dans le monde, quantifie le coût de cette absence de cap. Seules 5 % des organisations y sont qualifiées de future-built, c’est-à-dire celles qui capturent réellement de la valeur IA à l'échelle. 60 % d’entre elles – dites « retardataires » ou laggards – déclarent un retour nul ou marginal malgré des investissements significatifs. L'écart de performance entre les deux groupes est important : les entreprises future-built affichent une croissance de revenus 1,7 fois supérieure à celle des laggards, des marges EBIT 1,6 fois plus élevées, et un rendement actionnarial sur trois ans 3,6 fois plus fort que les retardataires. Le diagnostic rejoint l'analyse portérienne : trop d'entreprises ont abordé l'IA de manière incrémentale alors que l'enjeu est celui d'une réinvention stratégique. Ce qui distingue également les future-built : la quasi-totalité de leurs dirigeants sont personnellement engagés dans la stratégie IA (contre 8 % chez les retardataires), et 70 % de la valeur IA qu'elles capturent se concentre dans le cœur de métier, pas dans des cas d'usage périphériques.

L'enquête McKinsey confirme ce constat par un autre angle : les high performers sont 3,6 fois plus susceptibles que les autres de viser une transformation de leur modèle d'entreprise par l'IA (via par exemple de la croissance ou de l’innovation), et non un simple gain d'efficacité – objectif, lui, quasi universel et donc sans pouvoir différenciant.

Un cap stratégique suppose de répondre à au moins quatre questions :

Destination : Où l'organisation veut-elle être dans quelques années, et quel rôle spécifique l'IA joue-t-elle dans cette trajectoire ?

Avantage différentiel : Quelles fonctions, quels processus, quelles expertises constituent le cœur de la proposition de valeur, et comment l'IA le renforce-t-elle sans le diluer ?

Limites : Qu'est-ce que l'organisation ne fera pas avec l'IA, et pourquoi ? Cette question ne doit pas être négligée et est même un signe de maturité organisationnelle.

Mesure : Comment saura-t-on que l'IA crée la valeur attendue, et à quel rythme ?

Mais un cap seul ne se traduit pas spontanément en valeur. Il faut concevoir la manière dont l'IA intervient dans le travail.

II. Design : concevoir les interventions plutôt que les subir

L'enquête McKinsey le confirme : parmi les 31 pratiques organisationnelles testées, la reconception intentionnelle des workflows est l'un des facteurs qui distinguent le plus nettement les organisations performantes des autres. En effet, ces organisations sont près de trois fois plus susceptibles que les autres d'avoir fondamentalement reconçu leurs processus de travail. Ce résultat montre l’importance de la conception délibérée de l’insertion de l’outil dans le travail. C'est un exercice de design.

Automatiser ou amplifier

David Autor[6] et James Manyika[7] proposent un cadre qui clarifie cet exercice de design[8]. Toute intervention IA relève, en définitive, de l'une ou l'autre de deux logiques : l'automatisation ou l’amplification. Un outil d'automatisation est un système fermé qui élimine le besoin d'expertise humaine : le péage électronique remplace le guichetier, point. Un outil d'amplification est un multiplicateur de force qui n'a de valeur que si son utilisateur apporte l'expertise : un stéthoscope entre des mains non formées est un objet inerte. L'IA ne se range pas spontanément dans l'une ou l'autre catégorie : dans chaque application, elle automatise ou elle amplifie, selon la façon dont elle est conçue et dont on choisit de l'utiliser. Et la distinction a des conséquences directes : une mauvaise automatisation échoue, certes, mais elle interfère aussi avec l'expertise humaine, et parfois la détruit.

Une étude du MIT sur CheXpert[9], un outil d'IA diagnostic en radiologie, illustre le coût d'un mauvais choix de design : alors que l'IA surpassait isolément les deux tiers des radiologues, les médecins qui l'utilisaient posaient des diagnostics moins précis qu'en travaillant seuls. L'outil avait été conçu pour automatiser, pas pour coopérer : il ne communiquait ni son raisonnement ni ses zones d'incertitude, privant le praticien de toute base pour calibrer sa confiance dans la machine.

Autor et Manyika en tirent une leçon applicable bien au-delà de la radiologie : concevoir pour l’amplification signifie concevoir pour la complémentarité. Les avantages comparatifs de l'IA doivent s'insérer dans les zones où les experts humains peinent et le design doit préserver l'espace des forces distinctement humaines.

Ce qui reste humain

C'est bien là l'enjeu central du design : identifier ce qui, dans le travail à haute valeur ajoutée, relève du jugement expert, et ne peut être délégué. Autor et Manyika définissent les décisions expertes comme des choix à forts enjeux, ponctuels, où la bonne réponse n'est pas claire mais où la qualité de la décision détermine le résultat.

Cette distinction se traduit en questions que chaque organisation doit trancher :

Quelles tâches relèvent de l'automatisation pure ? On parle ici de fonctions où l'IA opère comme un système fermé, sans supervision experte requise.

Quelles tâches appellent une coopération experte ? Celles où l'IA informe, cadre, accélère, fournit une autre perspective, mais où l'humain reste décideur.

Où se situe la frontière, et comment évolue-t-elle ? La coopération n'est pas intrinsèquement meilleure que l'automatisation. Ce qui est destructeur, c'est de confier à l'IA la responsabilité d'une fonction entière quand ses capacités n’en couvrent qu'une fraction. Le travail de design consiste à tracer cette frontière et à la réviser régulièrement.

La deuxième question mérite qu'on s'y arrête. Autor et Manyika insistent sur un point structurant : entre experts, la coopération passe par la communication. On explicite un raisonnement, on isole un désaccord, on parvient parfois à une conclusion que ni l'un ni l'autre n'aurait atteinte seul. Une IA conçue pour l'amplification doit répondre au même standard : rendre son raisonnement lisible et ses incertitudes visibles, pour que l'expert puisse l'interroger, la corriger, et s'en servir comme d'un levier. Sans cette transparence, l'outil impose un choix binaire – accepter ou rejeter – et retombe dans une logique d'automatisation dégradée.

L'enquête McKinsey corrobore cette approche : parmi les facteurs qui distinguent le plus fortement les high performers, on trouve la définition explicite des cas où les outputs du modèle doivent faire l'objet d'une validation humaine, une pratique adoptée par 65 % des organisations les plus performantes, contre seulement 23 % des autres.

Au-delà de la réplication

Le piège le plus courant dans la conception des interventions IA est de se limiter à la réplication : reproduire ce que les humains font déjà, plus vite ou moins cher. L’étude du BCG propose une distinction éclairante entre trois niveaux d'intervention : le déploiement (gagner en efficacité sur les tâches), la transformation (reconcevoir des workflows entiers), et la réinvention (créer des capacités ou des offres nouvelles).

La plupart des organisations en sont encore au premier niveau. Pourtant, c'est aux deuxième et troisième niveaux que se joue la différenciation. Les données BCG montrent en effet que près de 90 % des entreprises future-built estiment que l'essentiel de leur valeur IA proviendra de la transformation et de la réinvention de leurs processus.

Deux cas tirés de cette même étude illustrent ce que la réinvention peut signifier concrètement. Un groupe mondial de produits de beauté a déployé en moins de douze mois un assistant virtuel intégré à ses parcours e-commerce sur plus de vingt marchés et huit marques, combinant consultation IA et personnalisation en temps réel. L'initiative ne réplique aucun processus existant, elle crée une capacité nouvelle d'engagement client permanent et personnalisé, avec un impact projeté de 100 M$ de revenus incrémentaux. Un fabricant de dispositifs électroniques a, quant à lui, centralisé des solutions d'IA agentique déployées sur plus de 200 usines, permettant une automatisation de 80 % des workflows opérationnels complexes, avec un impact modélisé de plus de 300 M$ sur l'EBIT.

Autor et Manyika observent toutefois une asymétrie préoccupante : les juniors tendent à traiter l'IA comme un oracle plutôt que comme un outil de coopération. Nous y reviendrons au pilier IV.

Le design des interventions IA, tel que décrit ici, concerne l'insertion de l'outil dans le travail individuel. Reste la question la plus politique : quel rôle lui donner dans la décision collective ?

III. Dynamique collective et gouvernance : décider du rôle de l'IA dans la délibération

Après avoir abordé la question de la stratégie et celle du design, d’autres restent ouvertes : quel rôle l’IA joue-t-elle dans les processus collectifs de délibération et de décision ? Est-elle un outil de support individuel, utilisé par chaque membre en amont de la réunion ? Une voix dans la délibération ? Un miroir des angles morts du groupe ? La réponse détermine si l'IA renforce ou dégrade l'intelligence collective de l'organisation.

L'IA comme acteur social

Le cadrage dominant – l’IA comme outil de productivité – est trompeur dès lors qu’on entre dans le champ de la décision collective. Une note préparée par une IA modifie ce que ses lecteurs vont percevoir comme important. Une recommandation formulée par un algorithme n’est pas entendue de la même façon qu’une opinion humaine : elle est soit surestimée par aura technologique, soit rejetée par aversion aux algorithmes. Ces deux réactions sont documentées par la recherche sur la confiance humain-IA, qui montre que la calibration de la confiance est l’un des défis centraux de tout système hybride[10].

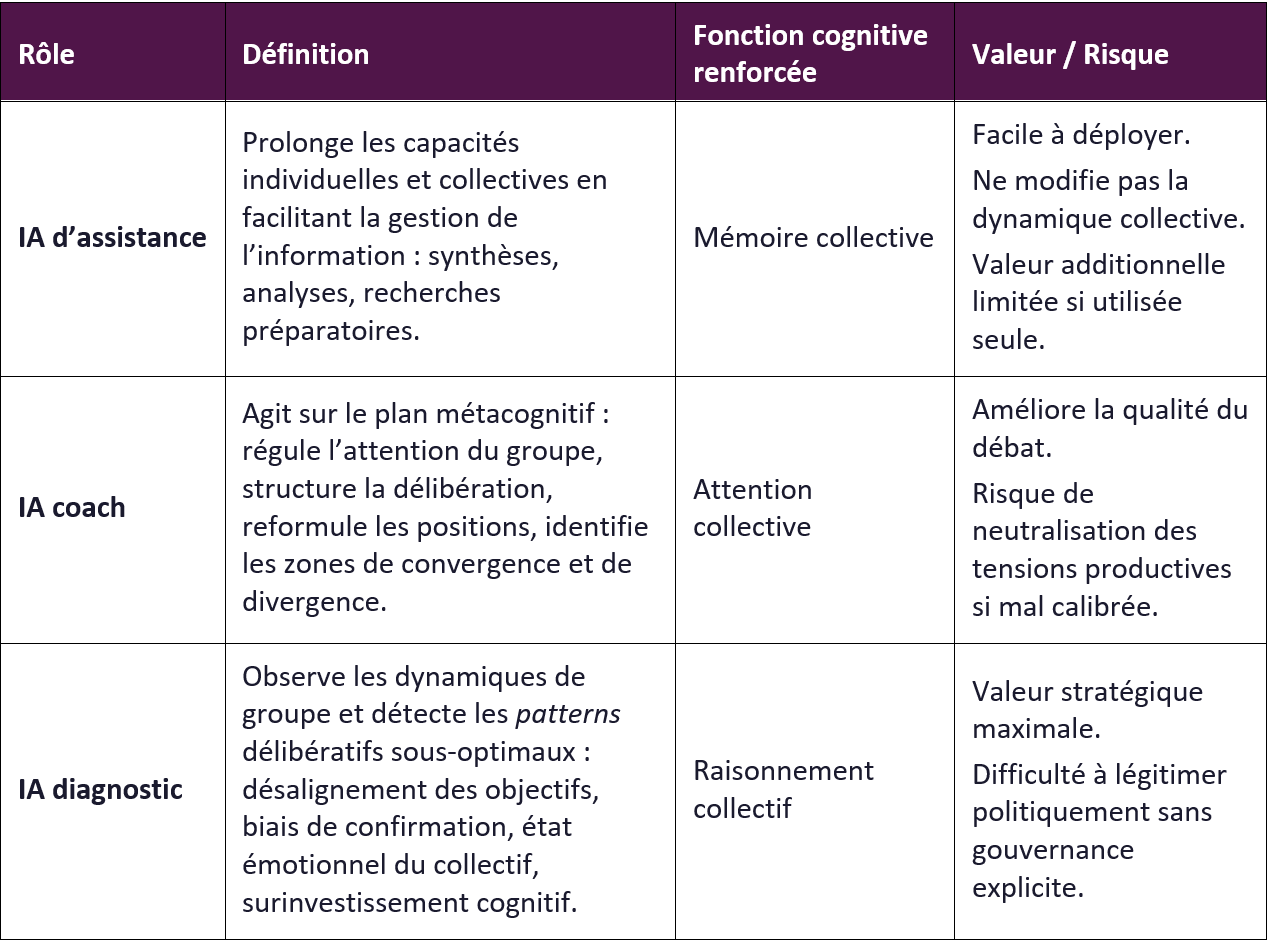

Pour penser cette question avec rigueur, il faut un cadre qui dépasse la vision instrumentale de l’IA. Les travaux de Pranav Gupta, Anita Woolley et leurs collègues sur l’intelligence collective humain-machine proposent justement un tel cadre[11]. Ils identifient trois systèmes transactionnels interindividuels permettant la mise en commun et la mobilisation des ressources cognitives du groupe. En découlent trois fonctions cognitives que tout système intelligent – biologique, technologique ou hybride – doit remplir pour faire montre d’une intelligence collective : la mémoire collective (qui sait quoi, et comment le mobiliser), l’attention collective (comment allouer les ressources cognitives limitées du groupe aux bonnes priorités), et le raisonnement collectif (comment aligner les objectifs individuels et collectifs face à un environnement changeant). Ces trois fonctions structurent trois rôles que l’IA peut jouer dans un collectif, bien au-delà du rôle d’assistant auquel la plupart des organisations l’ont confinée.

Trois rôles de l’IA dans un collectif

Source : LYVE Advisory, d’après Gupta et al. (2023).

La majorité des COMEX ont implicitement attribué à l’IA le premier rôle sans décider que c’était le bon choix, et souvent sans en mesurer les limites. Ce faisant, ils n’explorent pas les configurations à plus forte valeur ajoutée. Une enquête du Capgemini Research Institute menée auprès de 500 CXO (dont 100 CEO)[12] le mesure : 58 % des dirigeants interrogés déclarent un écart significatif entre le potentiel et l'usage réel de l'IA en contexte collectif (réunions de direction, comités, sessions stratégiques), contre seulement 28 % qui ressentent ce même écart dans leur usage individuel. Autrement dit, les dirigeants utilisent déjà l'IA comme assistant personnel mais ne l'ont pas encore insérée dans leur processus de décision collectif. Comme le résume Richard Goff, Chief Procurement Officer de WTW : « L'IA, c'est quelque chose que nous utilisons individuellement ou via nos équipes support. C'est très bien pour préparer les documents du comité, analyser des données publiques ou générer des insights avant les réunions. Mais en réunion, en situation de groupe, elle ne fait pas encore partie de la conversation. »[13]

Or la valeur se joue dans ce passage de l'individuel au collectif, et du support à l'amplification. La même enquête montre que les CXO qui utilisent l'IA principalement pour challenger leurs hypothèses et simuler des scénarios rapportent des gains 1,5 fois supérieurs en qualité de décision et 1,7 fois supérieurs en analyse d'impact par rapport à ceux qui cantonnent l'IA à un rôle de support de productivité (emails, comptes-rendus, documents). Le passage de l'assistant au coach, voire à l’agent de diagnostic, n'est donc pas simplement une idée conceptuelle mais un levier de performance mesurable.

Une analyse McKinsey[14] montre qu’en 2024, seules 39 % des entreprises du Fortune 100 déclaraient une quelconque forme de supervision de l’IA par leur Conseil d’administration (que ce soit via un comité, un administrateur avec une expertise IA ou un comité d’éthique). Par ailleurs, 66 % des administrateurs interrogés dans une enquête mondiale déclaraient une connaissance ou expérience « limitée à inexistante » de l’IA, et près d’un sur trois affirmait que l’IA ne figurait même pas à l’ordre du jour. Or le coût de cette absence est quantifiable : selon une étude du MIT Center for Information Systems Research[15], les organisations dont les Conseils d’administration sont compétents en matière d’IA – 26 % des conseils d’administration de l’échantillon 2024 étudié – surperforment leurs pairs de 10,9 points de pourcentage en rendement des capitaux propres (ROE), tandis que celles qui ne le sont pas se situent 3,8 % en dessous de la moyenne de leur secteur. Il apparaît ainsi que quand l’organe de gouvernance ne s’est pas saisi du sujet dans son propre espace de décision, la valeur se perd. De plus, moins de 30 % des entreprises déclarent que leur CEO est directement sponsor de leur agenda IA, ce qui a conduit à une prolifération d’initiatives déconnectées et une dispersion des investissements, avec une coordination limitée au niveau de l’entreprise[16].

Ces données confirment que l’IA reste par défaut confinée au rôle d’assistant tant que l’organe de gouvernance n’a pas décidé d’en faire autre chose. Elles soulignent surtout l’importance du tone from the top : c’est au niveau du COMEX et du Conseil que se décident le périmètre d’intervention de l’IA dans la délibération, les règles de validation humaine et l’allocation des moyens. Sans cette impulsion, les usages s’installent par accumulation de pratiques individuelles et la gouvernance collective de l’IA n’a tout simplement pas lieu.

L’IA, agent entropique

L’intégration de l’IA dans un organe délibératif n’est pas linéaire. Elle peut renforcer l’intelligence collective ou la dégrader. On appelle agent entropique une IA qui, par son mode d’intégration, érode les représentations partagées, rigidifie les comportements collectifs ou altère la dynamique de confiance au sein de l’équipe. L’entropie n’est pas dans l’outil lui-même mais dans la relation entre l’outil et le système dans lequel il opère.

Gupta, Woolley et leurs collègues ont mis en évidence ce mécanisme de manière expérimentale : un tableau de bord numérique conçu pour suivre les connaissances et spécialisations des membres d’une équipe a en réalité dégradé la cognition collective et la performance lorsque l’équipe était suffisamment petite pour gérer ces informations sans outil[17]. L’outil bien intentionné a déplacé un processus cognitif que le groupe maîtrisait déjà, substituant une dépendance technologique à une compétence collective existante. Transposé aux Conseils et aux COMEX, le scénario est reconnaissable : chaque membre arrive en réunion avec « sa » synthèse IA, les synthèses ne convergent pas, et le débat porte sur les outputs de la machine plutôt que sur le problème lui-même. L’outil a fragmenté l’attention collective au lieu de l’organiser.

Les auteurs soulignent un point fondamental pour les équipes dirigeantes : des outils d’IA qui privent les membres d’autonomie en gérant intégralement les flux de travail peuvent saper la motivation et la qualité de l’intégration des travaux de l’équipe. Autrement dit, une IA qui « fait le travail » à la place du collectif ne renforce pas l’intelligence hybride, elle la court-circuite. L’enquête Capgemini confirme que ces deux mécanismes – sur-dépendance et déficit de compréhension – sont les préoccupations dominantes des dirigeants eux-mêmes : 69 % citent la difficulté à expliquer les décisions influencées par l'IA comme une inquiétude majeure, et 45 % identifient la sur-dépendance aux outputs IA comme un risque de premier plan. Pourtant, seules 34 % des organisations disposent de protocoles de gouvernance, de responsabilité et de conformité adaptés alors que 67 % des CXO déclarent que de tels protocoles les aideraient à mieux utiliser l'IA dans leurs décisions. Ce décalage entre le besoin ressenti et l'infrastructure disponible signifie concrètement que dans la majorité des organisations, les membres des équipes dirigeantes reçoivent des outputs IA sans cadre pour en évaluer la fiabilité.

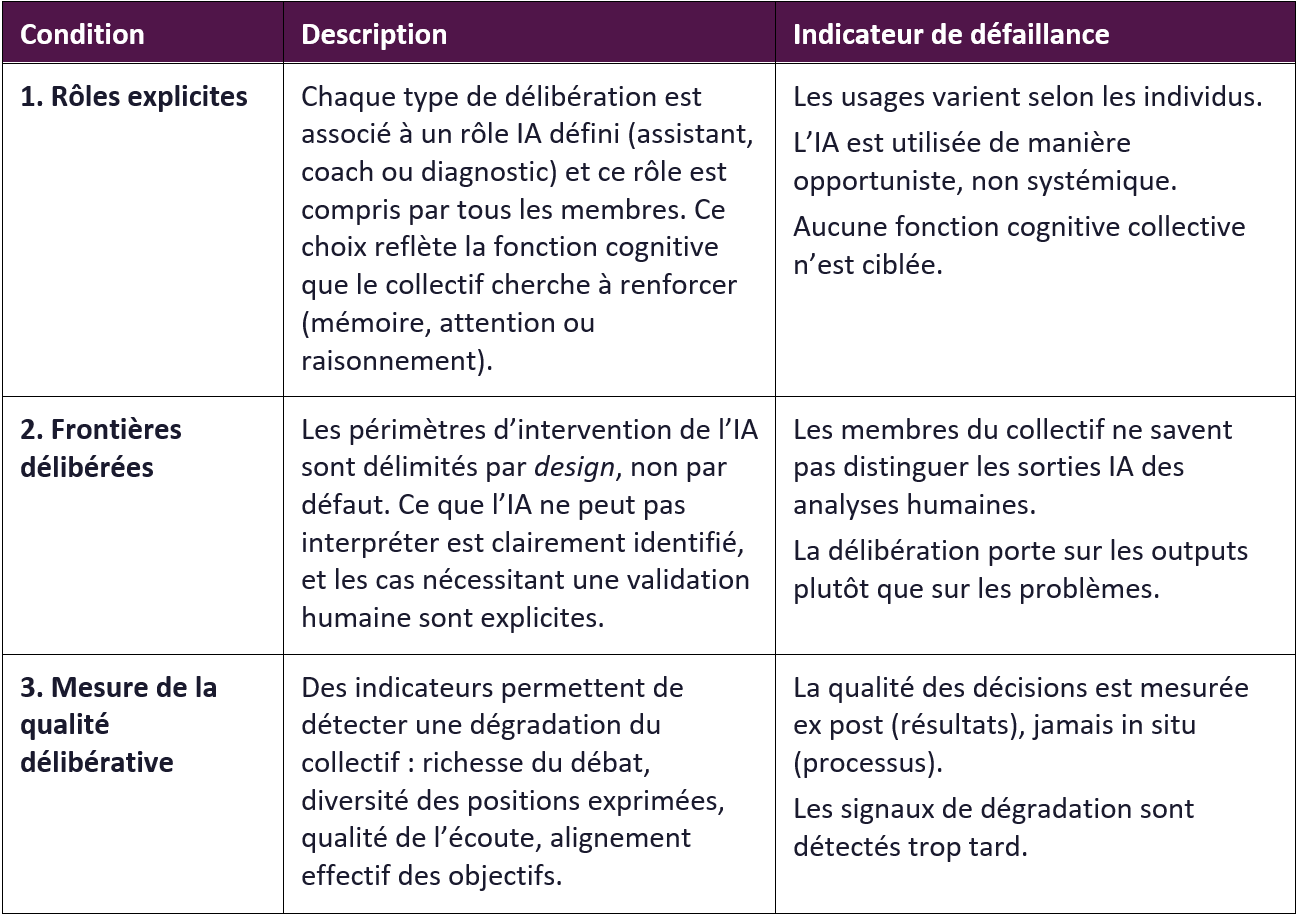

L’intelligence hybride – définie par Dellermann et al. comme la capacité d’atteindre des objectifs complexes en combinant intelligence humaine et artificielle, de manière à obtenir des résultats supérieurs à ceux que chacune pourrait atteindre séparément et à être dans une démarche d’amélioration continue en apprenant l’une de l’autre[18] – est un choix d’architecture. Les analyses qui précèdent permettent de formuler trois conditions structurantes pour qu'un collectif dirigeant développe une intelligence hybride robuste.

Intelligence hybride : trois conditions et leurs signaux d'alerte

Sources : LYVE Advisory, d’après Gupta et al. (202"3) et Dellermann et al. (2019).

Les deux premières conditions sont adossées aux constats développés plus haut. La troisième condition est la plus exigeante et la moins pratiquée. Gupta, Woolley et leurs collègues identifient des marqueurs observables d'un système transactionnel fonctionnel : différenciation des connaissances et émergence des spécialisations, patterns d'attention synchrone entre les membres du groupe, niveau d'effort collectif et engagement individuel. Or ces marqueurs portent sur le processus, pas sur le résultat. Dans la pratique des organes dirigeants, la qualité délibérative est le plus souvent évaluée ex post, par la qualité perçue des décisions, rarement in situ, par la qualité du processus qui les produit. En pratique, pour un CA ou un COMEX, ces marqueurs pourraient devenir des indicateurs concrets : diversité des positions exprimées avant convergence, temps alloué au débat contradictoire, fréquence des remises en question des sorties IA.

La plupart des déploiements IA actuels ne remplissent pas ces trois conditions. Et quand bien même ils le feraient, une architecture bien conçue ne produit ses effets que si les membres de l'organisation sont en mesure de se l'approprier.

IV. Pédagogie : déconstruire, reconstruire, et ne pas oublier les juniors

Les trois premiers piliers concernent le système. Le quatrième concerne les personnes. Une fois la stratégie posée, le design défini, la dynamique collective et la gouvernance formalisées, il reste à s'assurer que les membres de l'organisation sont en mesure de travailler avec l'IA. Ce travail pédagogique ne relève pas de la formation technique mais porte sur le jugement, et il concerne tous les niveaux de l'organisation – y compris les dirigeants.

Une appropriation encore inachevée

Autor et Manyika l'ont observé dans le cadre présenté au pilier II : les professionnels expérimentés utilisent spontanément l'IA comme un outil de coopération pour confronter leurs intuitions et affiner leurs raisonnements ; les profils juniors tendent à la traiter comme un oracle, une source de réponses définitives qu'ils n'ont pas les moyens de vérifier. Cette asymétrie n'est pas seulement un problème de juniors. Elle signale que la majorité des utilisateurs n'ont pas été formés à collaborer avec un système dont la compétence est réelle mais les limites pas toujours visibles.

L'enquête Capgemini le confirme à l'échelle du C-suite : seuls 33 % des dirigeants interrogés déclarent savoir articuler leurs besoins à un système d'IA générative, et 38 % se sentent confiants dans leur capacité à formuler des requêtes efficaces. Plus frappant encore, 52 % des CXO ne communiquent pas activement sur le rôle de l'IA dans leurs décisions, ni en interne ni en externe, et parmi ceux qui refusent d'en parler publiquement, 72 % citent le risque de réputation si une décision influencée par l'IA devait avoir un impact négatif. Ce silence est le symptôme d'une appropriation inachevée. On utilise l'IA, mais on n'assume pas de le faire, parce qu'on ne maîtrise pas suffisamment l'outil pour en défendre l'usage devant un Conseil d'administration ou un Comité d'audit.

C'est cette maîtrise, au niveau des dirigeants, qui donne aux trois piliers précédents une chance de produire leurs effets.

L'angle mort des populations juniors

L'IA ne détruit pas encore massivement les emplois mais elle pourrait fermer des portes d'entrée. Une étude d'Anthropic sur les impacts de l'IA sur le marché du travail[19] révèle que si le chômage n'a pas encore significativement augmenté dans les métiers les plus exposés, on observe des signaux précoces d'un ralentissement de l'embauche des jeunes travailleurs de 22 à 25 ans dans ces mêmes métiers, avec une baisse de 14 % du taux d'entrée en emploi par rapport à 2022 dans les professions les plus exposées.

Et pour les juniors qui entrent, le paysage est différent de celui de leurs prédécesseurs. L'étude de Brynjolfsson, Li & Raymond, citée dans notre introduction, montre que ce sont les agents les moins expérimentés qui bénéficient le plus des outils d'IA. Un agent disposant de deux mois d'ancienneté et d'un accès à l'assistant IA performe aussi bien qu'un agent de six mois sans accès. La courbe d'apprentissage s'accélère de manière franche. Ces gains de performance immédiate sont réels mais ils masquent une question que trop d'organisations esquivent.

Dans des métiers comme le conseil, la finance ou le droit, les professionnels juniors construisent leur jugement en faisant. En due diligence, un analyste junior développe sa lecture critique en traitant de nombreux documents, en repérant des incohérences, en apprenant par l'erreur et par la correction. En stratégie, il affine sa pensée en structurant des analyses, en défendant des hypothèses devant des seniors qui les challengent. Si un agent IA absorbe ces tâches formatives, la question se pose : qui forme les seniors de demain, et par quel chemin ?

La réponse doit être construite délibérément, dans le cadre même de la démarche de design décrite au pilier II : quels parcours d'apprentissage préserver ? Comment concevoir des interventions IA qui augmentent les juniors plutôt que de les contourner ? Le cadre d’Autor et Manyika trouve ici son application pédagogique : une IA conçue pour l'amplification peut donner au junior accès à des feedbacks plus riches et plus rapides sur son propre travail, signaler les incohérences qu'il a manquées dans une analyse, lui proposer des documents similaires pour comparer ses conclusions, lui offrir un contradicteur disponible en permanence.

Construire avec la prochaine génération, et non simplement optimiser pour la génération en place, est une responsabilité de gouvernance à part entière.

La valeur de l'IA ne réside pas dans la technologie déployée mais dans la qualité des choix qui encadrent son déploiement. Ces choix – où l'IA intervient, selon quelle logique et quelle dynamique collective, sous quelle gouvernance, avec quel investissement dans les compétences – sont indissociables, et les traiter séquentiellement, c'est perdre le bénéfice de chacun.

Ces décisions relèvent des équipes dirigeantes, et d'elles seules. Aucun fournisseur de technologie, aucun benchmark sectoriel ne s'y substituera. Dans un environnement d'incertitude radicale, elles n'ont pas vocation à être définitives. Elles se renouvellent et s'affinent au contact de la réalité. Mais elles doivent exister : explicites, partagées, gouvernées – plutôt que laissées à l'accumulation de décisions tactiques que personne n'a validées.

___

À propos de LYVE Advisory

LYVE Advisory intervient auprès des Conseils d'Administration, Directions Générales et COMEX pour structurer les choix stratégiques liés au déploiement de l'IA : positionnement, design des interventions, gouvernance collective et capacité des équipes dirigeantes à piloter l'IA dans leur propre espace de décision.

Notre accompagnement couvre l'ensemble de la chaîne pour faire de l'IA un levier d'intelligence organisationnelle.

Contact : contact@lyve-advisory.com | www.lyve-advisory.com

[1]Generative AI at Work, Erik Brynjolfsson, Danielle Li, Lindsey Raymond, The Quarterly Journal of Economics, Volume 140, Issue 2, May 2025, Pages 889–942

[2]The state of AI in 2025: Agents, innovation, and transformation, Alex Singla, Alexander Sukharevsky, Bryce Hall, Lareina Yee, and Michael Chui, with Tara Balakrishnan, representing views from QuantumBlack, AI by McKinsey, November 2025

[3]What Is Strategy?, M. E. Porter, Harvard Business Review, November – December 1996

[4]The Iron Cage Revisited: Institutional Isomorphism and Collective Rationality in Organizational Fields, Paul J. DiMaggio and Walter W. Powell, American Sociological Review, Vol. 48, No. 2 (Apr., 1983), pp. 147-160, American Sociological Association

[5]The Widening AI Value Gap, Build for the Future 2025, BCG, by Jessica Apotheker, Vinciane Beauchene, Nicolas de Bellefonds, Patrick Forth, Marc Roman Franke, Michael Grebe, Nina Kataeva, Santeri Kirvelä, Djon Kleine, Romain de Laubier, Vladimir Lukic, Amanda Luther, Mary Martin, Jeff Walters, and Christoph Schweizer, September 2025

[6]Economiste étatsunien, professeur au Massachusetts Institute of Technology

[7]Senior Vice President de Google, docteur en IA, ancien directeur du McKinsey Global Institute

[8]A Better Way to Think About AI, Artificial intelligence is ready to collaborate. Why fixate on automation? By David Autor and James Manyika, The Atlantic, August 24, 2025

[9]Combining Human Expertise with Artificial Intelligence: Experimental Evidence from Radiology, Nikhil Agarwal, Alex Moehring, Pranav Rajpurkar, Tobias Salz, April 30, 2024

[10]Human Trust in Artificial Intelligence: Review of Empirical Research, Glikson, E. & Woolley, A. W. (2020), Academy of Management Annals, 14(2), pp. 627–660.

[11]Fostering Collective Intelligence in Human–AI Collaboration: Laying the Groundwork for COHUMAIN, Gupta, P., Nguyen, T. N., Gonzalez, C. & Woolley, A. W. (2023),Topics in Cognitive Science, 17(2), pp. 189–216

[12]Inside the C-Suite: How AI is quietly reshaping executive decisions, Jerome Buvat, Subrahmanyam Kanakadandi, Amol Khadikar, Vaishnavee Ananth, Parvathi M Kaloor, Research brief, Capgemini Research Institute, 2026

[13]Traduction par l’autrice

[14]The AI reckoning: How boards can evolve How can boards best help guide companies through the competitive dynamics unleashed by AI?, by Aamer Baig, Ashka Dave, Celia Huber, and Hrishika Vuppala, McKinsey & Company, December, 2025

[15]Research Briefing, Digitally Savvy Boards: AI Update, We compare the results of 2019 and 2024 studies on board digital savvy, augmented with insights from director interviews and an initial analysis of board committees, By Peter Weill, et al, Mar 20, 2025

[16]Seizing the agentic AI advantage, A CEO playbook to solve the gen AI paradox and unlock scalable impact with AI agents, by Alexander Sukharevsky Dave Kerr Klemens Hjartar Lari Hämäläinen Stéphane Bout Vito Di Leo Guillaume Dagorret, QuantumBlack AI by McKinsey, June 2025

[17]Cf. note de bas de page #11

[18]The Future of Human-AI Collaboration: A Taxonomy of Design Knowledge for Hybrid Intelligence Systems, Dellermann, D.; Calma, A.; Lipusch, N.; Weber, T.; Weigel, S. & Ebel, P., Hawaii International Conference on System Sciences (HICSS), 2019

[19]Labor market impacts of AI: A new measure and early evidence, Economic research, Anthropic, Written by Maxim Massenkoff and Peter McCrory, March, 2026